摘要:昨日Runway宣布,即将在视频生成工具Gen-2中上线「MotionBrush」(运动笔刷)功能,一种可控制生成内容移动的新方法。当然,Gen-2也是有竞争对手的,就是PikaLabs,特别是后者还是免费的。...

文章转载来源:机器之心

原文来源:机器之心

图片来源:由无界 AI生成

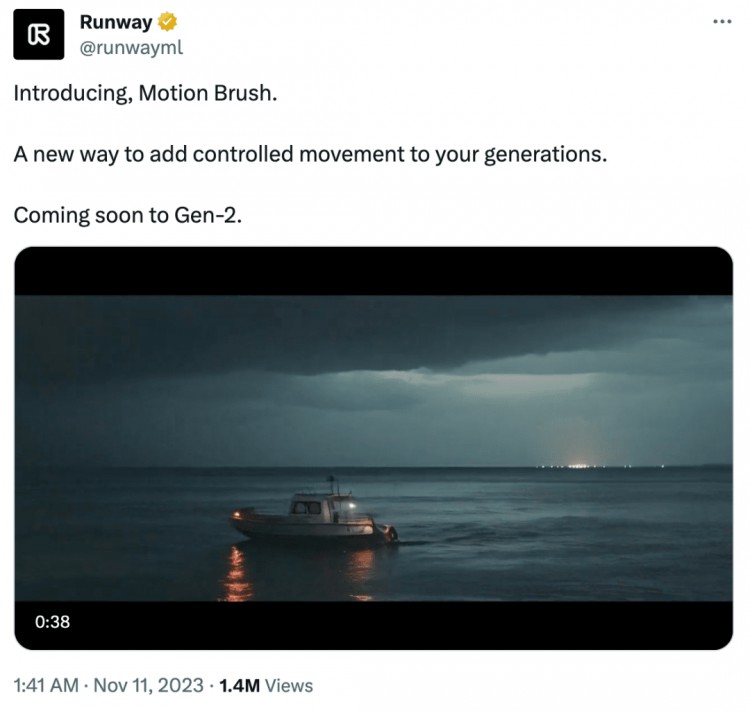

一段50秒的预告视频,再次让一段50秒的预告视频, AI 圈沸腾了。

昨日 Runway 宣布即将生成视频工具 Gen-2 中上线「Motion Brush」(运动笔刷)功能是一种新的控制内容移动的方法。

这个游戏,甚至不需要输入文字,只要有手就够了。

任何图片,画笔涂抹在哪里,立即动起来:

无论是水流、云、火焰、烟雾还是人物,都能高度还原其动态。这就是传说中的传说。「点石成金」吗?

网友看完后说:我无法想象一年后视频技术会有多先进...

因为在 2023 今年年初,从文本中生成视频还是相当困难的。

Runway 曾在今年 2 月推出了 Gen-1、功能非常丰富,包括风格化、故事版、蒙版、渲染、自定义等。这似乎是一个专注于它的问题。「编辑」视频工具。

但今年 3 月,Gen-2 它的出现改变了一切,增加了文本和图片生成视频的功能。客户只需输入文本、图像或文本和图像描述,Gen-2 相关视频可以在很短的时间内生成。

这是市场上第一个公开可用的文本到视频模型。例如,输入一段文本。「午后的阳光透过纽约阁楼的窗户照进来」,Gen-2 会直接「脑补」出视频:

现在,只有几个 prompt 和手势一起,我们可以生成像样的视频并进一步编辑,复杂的视频编辑软件和复杂的制作过程一去不复返。

假如文生图神器 Midjourney 文生视频神器 Gen-2 结合使用,客户不能下笔,直接出大片。

当然,Gen-2 也有竞争对手,也就是说,有竞争对手 Pika Labs,特别是后者是免费的。

以上画面由 Pika Labs 生成。

一些用户非常期待这种疯狂卷的趋势:「2024 年,Pika Labs 和 Runway 它们之间的拉扯一定很有趣。」

传闻中,OpenAI 还有与视频生成相关的技术。有网友表示:「这让我不禁好奇,OpenAI 的 any-to-any 该模型在生成视频方面有多出色,因为该公司通常走在别人面前。」

未来的视频和电影制作行业会颠覆吗?